De opkomst van de machines! De echte reden om bang te zijn voor AI-systemen, die sinds jaren onderdeel zijn van ons leven… Hoe satan alles verdraait.

Eindtijdnieuws.com

23 mei 2022

Een robotica-onderzoeker, die ‘bang is voor robots’, nodigt ons uit in zijn wereld om te begrijpen waar de bedreigingen van robots en kunstmatige intelligentie liggen, ofwel: maakt u door middel van leugens en humor wijs wie de ‘werkelijke bedreigingen’ zijn… en de mensen vallen ervoor!

Peter Haas sprak zowel op TED- als Echoing Green-beurzen. Hij is een spreker geweest bij TED Global, The World Bank, Harvard University en andere locaties. Hij heeft een Bachelor Filosofie, ja, van Yale. Deze lezing werd gegeven op een TEDx-evenement. Let goed op de manier van hersenspoelen van zijn gehoor, de aanwezigen in de zaal:

The Real Reason to be Afraid of Artificial Intelligence | Peter Haas | TEDxDirigo

Translation => Options (gear wheel) > Subtitles > Automatic translation > Choose your language

Transcriptie gedeeltelijk en vrij vertaald:

15-12-2017 De opkomst van de machines!

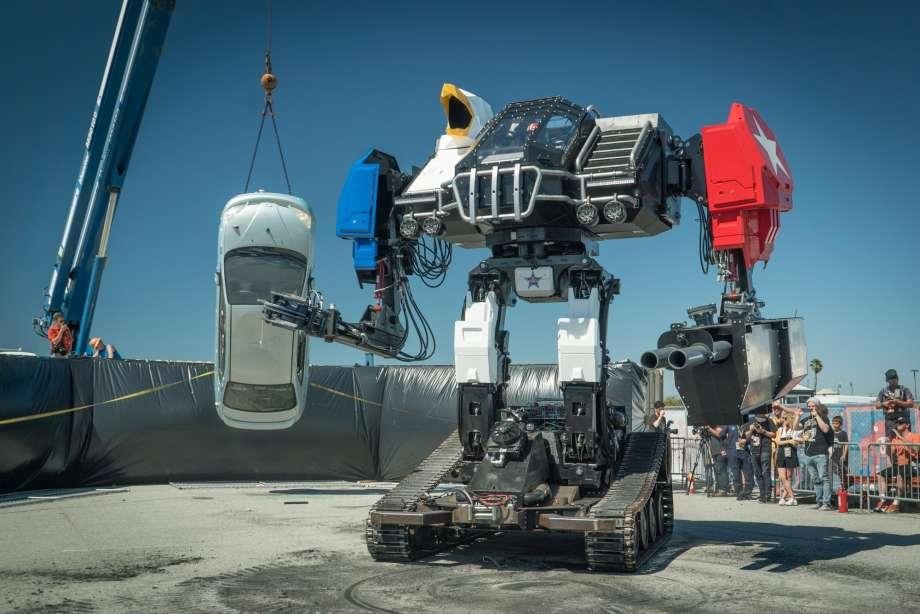

Wie is hier bang voor killer robots? (gelach) Ik ben bang! [Ja, je kunt niet beter beginnen en binnenkomen dan met zo’n ijsbreker.]

Ik werkte in UAV’s, onbemande luchtvaartuigen. En het enige wat ik kon denken, toen ik deze dingen zag, is dat op een dag iemand een machinegeweer aan deze dingen zal vastmaken, en dan zullen ze mij in zwermen opjagen. [Dit is voorspellend programmeren, lieve mensen.]

Ik werk in de robotica aan de Brown University, en ik ben bang voor robots

Eigenlijk ben ik heel erg bang, maar kun je het me kwalijk nemen? Sinds ik een kind was, heb ik alleen maar films gezien, die de opkomst van kunstmatige intelligentie (AI), en ons onvermijdelijke conflict ermee, uitbeeldden: 2001 A Space Odyssey, Terminator, The Matrix… en de verhalen die ze vertellen, zijn behoorlijk angstaanjagend. Rebelse bendes van mensen, die weglopen van superintelligente machines. [Mensen hoeven niet altijd rebels te zijn in zo’n situatie… misschien wel rebels tegen het beest systeem van de NWO.] Dat maakt me bang. Uit de handen, die omhooggingen, lijkt het alsof u er ook bang voor bent.

Ik weet dat het eng is voor Elon Musk

[Laat me niet lachen! Ziet u de leugens en het conditioneren?]

Maar weet u, we hebben nog wat tijd, voordat de robots opstaan. Robots, zoals de PR2, kunnen de deur nog niet eens openen. [Ik betwijfel het.] Dus in mijn gedachten is deze discussie over superintelligente robots een beetje een afleiding van iets veel verraderlijkers, dat gaande is met AI-systemen in het hele land. Ziet u, op dit moment zijn er mensen – artsen, rechters, accountants – die informatie krijgen van een AI-systeem. Zij behandelen het, en gaan met AI om, alsof het informatie is van een vertrouwde collega! [Sommigen beweren dat AI nog moet komen, maar we worden er al jaren door omringd en geconditioneerd, niet alleen via uw smartphone.] Het is dit vertrouwen dat me stoort, niet vanwege het feit hoe vaak AI het bij het verkeerde eind heeft.

AI-onderzoekers zijn trots op de nauwkeurigheid van de resultaten

[Is AI nu onnauwkeurig of nauwkeurig?] Het is de mate waarin het fout gaat, wanneer AI een fout maakt waar ik me zorgen over maak. Deze systemen falen niet gracieus. Laten we dus eens kijken hoe dit eruit ziet…

Dit is een hond, die door AI-algoritme verkeerd werd geïdentificeerd als wolf

De onderzoekers wilden weten: waarom werd deze specifieke husky verkeerd geïdentificeerd als een wolf? Dus herschreven zij het algoritme, om aan hen [wie is hen?] uit te leggen op welke delen van de afbeelding het gelet had, toen het AI-algoritme zijn beslissing nam. Waar denkt u dat het aandacht aan besteedde op deze foto? En waar zou u op letten? Misschien de ogen, misschien de oren, de snuit… Nee, hier werd op gelet: vooral de sneeuw en de achtergrond van de foto! Ziet u, er zat vertekening in de set gegevens, die naar dit algoritme werd gevoerd. De meeste foto’s van wolven waren wolven in de sneeuw. Dus het AI-algoritme voegde de aan- of afwezigheid van sneeuw samen met de aan- of afwezigheid van een wolf! Het enge hieraan is, dat de onderzoekers geen idee hadden dat dit gebeurde, totdat ze het algoritme herschreven! En dat is het probleem met AI-algoritmes, deep learning, machine learning…

Zelfs de ontwikkelaars die aan dit spul werken, hebben geen idee wat AI doet!

Wat betekent dit in de echte wereld? Het COMPAS Criminal Sentencing-algoritme (AI) wordt in 13 staten in de VS gebruikt. Dit is een echt systeem, dat in de echte wereld door echte rechters wordt gebruikt om beslissingen te nemen over het leven van echte mensen! Dit deel van het AI-systeem lijkt echter vooringenomenheid te vertonen; desondanks gebruiken ze het. De reden dat ze COMPAS gebruiken, is omdat het zeer efficiënt werkt. COMPAS laat ze veel sneller dossiers verwerken in een achtergebleven strafrechtelijk systeem.

Waarom zouden ze hun eigen software in twijfel trekken?

Het is aangevraagd door de staat, goedgekeurd door hun IT-afdeling. Waarom zouden ze het in twijfel trekken? Nu, de mensen die door COMPAS zijn veroordeeld, hebben het in twijfel getrokken! Het schijnt dat het AI-systeem niet ‘op de juiste manier werd gebruikt’. Men oordeelde dat de beklaagde de broncode van COMPAS niet mocht inkijken. OK, het moet correct worden gebruikt, maar je mag de broncode niet inspecteren? Dit is zeer verontrustend voor iedereen, die strafrechtelijk wordt veroordeeld!

Wel, het kan u misschien niets schelen, omdat u niet strafrechtelijk wordt veroordeeld.

‘Black box’ AI-algoritmes

Maar wat als ik u zou vertellen, dat ‘black box’ AI-algoritmes, zoals deze, worden gebruikt om te beslissen of u al dan niet een lening voor uw huis kunt krijgen, of u een sollicitatiegesprek krijgt voor een baan, of u medische hulp krijgt, en zelfs of u wel of niet auto’s en vrachtwagens over de snelweg mag rijden? Zou u willen, dat het publiek het algoritme kan inspecteren: het AI-systeem, dat een beslissing probeert te nemen tussen een winkelwagentje en een kinderwagen in een zelfrijdende vrachtwagen, op dezelfde manier waarop het hond/wolf-algoritme probeerde te kiezen tussen een hond of een wolf? Bent u een mogelijke, metaforische ‘hond’, die door iemands AI-algoritme verkeerd wordt geïdentificeerd als een wolf? Gezien de complexiteit van mensen, is dat mogelijk!

Kunt u er nu iets aan doen?

Waarschijnlijk niet, en daar moeten we ons op concentreren. We moeten normen voor verantwoording eisen, en transparantie in AI-systemen. ISO, de Internationale Organisatie voor Standaardisatie, heeft zojuist een commissie gevormd, om beslissingen te nemen over wat te doen voor AI-normen. Ze zijn ongeveer vijf jaar verwijderd van het bedenken van een standaard. [Ach ja, natuurlijk! Ze zijn gewoon deel van de club.]

Deze AI-systemen worden nu (in 2017) gebruikt…

niet alleen voor leningen en hypotheken, maar ze worden ook gebruikt in voertuigen, zoals ik al zei. Ze worden gebruikt in zaken als Cooperative Adaptive Cruise Control (CACC). Het is grappig dat ze dat ‘cruise control’ noemen, omdat het type controller, dat in cruise control wordt gebruikt, – een PID-regelaar – al 30 jaar in chemische fabrieken wordt gebruikt, nog vóórdat er ooit een auto van werd gemaakt! Het type controller of regelaar, dat wordt gebruikt om een zelfrijdende auto te besturen, en wordt gebruikt in machine learning, – dat werd pas sinds 2007 in onderzoek gebruikt.

Dit zijn nieuwe technologieën

[Of zijn het misschien niet zulke nieuwe technologieën, maar worden ze nu aan het publiek onthuld?]

We moeten strenge normen ontwikkelen, we moeten wetgeving vereisen, zodat we geen ‘slangenolie’ op de markt krijgen. [De oude slang, satan, zal hoe dan ook zijn robottechnologie op de markt krijgen.]

En we moeten ook een beetje sceptisch zijn

De ‘experimenten in autoriteit’ [‘experimenten in gehoorzaamheid aan onze overheden’], die na de Tweede Wereldoorlog door Stanley Milgram werden uitgevoerd, toonden aan dat de gemiddelde persoon de bevelen van een autoriteit zal opvolgen, zelfs als dit zou betekenen dat hij zijn medeburger ernstig zou schaden of laten lijden. In dit experiment zou de gemiddelde Amerikaan een acteur een elektrische schok toebrengen, voorbij het punt dat hij klaagde over zijn problemen, voorbij het punt dat hij schreeuwde van de pijn van de schok, voorbij het punt dat hij zweeg in een gesimuleerde dood… allemaal omdat iemand, zonder diploma’s, in een laboratoriumjas, hem vertelde dat ‘het experiment moest doorgaan’. [Tijdens het experiment wisten deze Amerikanen niet dat het om een acteur ging.]

In AI hebben we een emotieloos, gevoelloos systeem

Een systeem, dat niet kan reflecteren, dat geen andere beslissing kan nemen, en waar geen beroep op kan worden gedaan. Een systeem dat altijd zal zeggen: ‘Het systeem (of het proces) moet doorgaan’.

We rijden momenteel ‘in de regen’ met AI

En die regen zal in sneeuw veranderen. En die sneeuw kan een sneeuwstorm worden. We moeten pauzeren, de voorwaarden checken, veiligheidsnormen instellen, en ons afvragen hoever we willen gaan. Want, [mag hij u alvast vertellen] de economische prikkels voor AI en automatisering, om menselijke arbeid te vervangen, zullen alles wat we sinds de industriële revolutie hebben gezien, overtreffen! Menselijke salariseisen kunnen niet concurreren met de basiskosten van elektriciteit. [Wij mensen zijn dus een ballast voor de elite, waar ze vanaf willen.] AI’s en robots zullen frituurkoks, fastfoodketens, en radiologen in ziekenhuizen vervangen. Op een dag zal de AI uw kanker diagnosticeren, en een robot zal de operatie uitvoeren.

Alleen een gezond wantrouwen ten aanzien van AI-systemen zal mensen op de hoogte houden

[Maar denkt u nu echt dat de elite ons netjes op de hoogte zal houden en eerst om uw goedkeuring zal gaan vragen?] En ik ben ervan overtuigd dat, als we mensen op de hoogte kunnen houden, als we transparante AI-systemen kunnen bouwen, zoals het voorbeeld van de hond/wolf, waar de AI uitlegde wat het mensen aandeed, en mensen het ter plekke konden controleren, dat we dan nieuwe banen kunnen creëren: banen voor mensen, die samenwerken met AI. Als we samenwerken met AI, kunnen we waarschijnlijk enkele van onze grootste uitdagingen oplossen. [‘Orde uit chaos’] Maar om dat te doen, moeten we leiding geven en niet volgen. We moeten ervoor kiezen om minder op robots te lijken, en we moeten de robots bouwen, om meer op mensen te lijken, want uiteindelijk is het enige waar we bang voor moeten zijn niet de killer robots. Nee, het is onze eigen ‘intellectuele luiheid’ [een mooi woord voor ‘domheid’]. Het enige waar we bang voor hoeven te zijn, zijn wijzelf. Dank u. (applaus publiek)

Wow, wat een uitspraak!

Een uitspraak, die ertoe leidt dat we onze naasten meer en meer zullen wantrouwen, zelfs zullen haten. Een uitspraak, die maakt dat we robots en AI-systemen zullen omarmen, omdat ze betrouwbaarder zouden zijn dan mensen. Het AI-systeem van de gevallen engelen is goed, en wij mensen zijn slecht. Iemand doden, eenvoudig omdat de autoriteiten je dit opdragen en hierop blijven aandringen, is goed, maar de autoriteiten hierin juist niet gehoorzamen, is weer fout. Killer robots zijn goed, maar wij mensen zijn slecht, gevaarlijk, dom en lui… vul maar in:

Wee hun die het kwade goed noemen en het goede kwaad; die duisternis voorstellen als licht en licht als duisternis; die bitter doen doorgaan voor zoet en zoet voor bitter. Jesaja 5, vers 20

Jezus zei:

“Gij hebt de duivel tot vader en wilt de begeerten van uw vader doen. Die was een mensenmoorder van den beginne en staat niet in de waarheid, want er is in hem geen waarheid. Wanneer hij de leugen spreekt, spreekt hij naar zijn aard, want hij is een leugenaar en de vader der leugen.” Johannes 8:44

Verbaast u zich niet als blijkt dat websites geheel of gedeeltelijk worden gerund door AI, en social media platforms kunstmatige opmerkingen en scripts genereren om het onwetende volk te hersenspoelen. Verbaas u ook niet, wanneer misschien zelfs het script van deze spreker gedeeltelijk of geheel tot stand is gekomen middels een AI-programma! Nu ik hierover schrijf, laat ik eens een korte zoekactie doen op het internet. En jawel, het internet meldt dat dit een feit is, in het volle zicht:

Robotredacteurs kunnen uw dagelijks nieuws schrijven!

‘Wist u dat AI-programma’s nieuwsberichten kunnen schrijven? The Washington Post bijvoorbeeld gebruikt een op AI gebaseerd computersysteem, Heliograf (door WaPo zelf ontwikkeld), dat verhalen schrijft over sportwedstrijden, misdaad, of de verkiezingen (politiek!). Heliograf werkt met sjablonen: stukken tekst, die journalisten van tevoren zelf schrijven, en die door het systeem worden verrijkt met de meest recente data. Ze worden zó geschreven dat ze inzetbaar zijn voor honderden verschillende berichten! Als die sjablonen eenmaal goed werken, publiceert de computer automatisch nieuwsberichten, zonder tussenkomst van een persoon. Ook persbureau Associated Press (AP ofwel APnews) publiceert al sinds 2014 berichten over sport en business met behulp van zo’n robotredacteur.’

Beide websites worden overigens gerund door Vrijmetselaren. Het zou me daarom ook helemaal niet verbazen wanneer zij, net als CNN, occulte numerologie gebruiken in hun dagelijkse nieuwsberichten, die worden gegenereerd door middel van AI.

Don’t be scared; be prepared

Bron: